文/NoblerSubtlety793

生成式 AI 的出現,讓我們得以見證科幻和現實的交融。 在接著要講各種不同生成式AI軟體之前, 我們來了解一下生成式AI的基本概念

在介紹不同生成式 AI 軟體之前,了解生成式AI的基本原理 這是必不可少的基礎。

👉👉什麼是生成式 AI?

生成式 AI(Generative AI),即人工智慧生成內容,又稱 AIGC(AI Generated Content)。生成式 AI 是人工智慧中的一個重要分支,主要應用於創造性的工作。它讓電腦能模仿人類的創造力,產生出新的、原創的、有意義的內容。

生成式 AI 的主要組成元素包括:

神經網絡:

神經網絡是生成式 AI 的核心構建塊,尤其是深度神經網絡(DNN)。這些網絡能夠捕捉數據中的複雜模式和特徵。

生成對抗網絡(GAN):

GAN 是一種重要的生成模型,由生成器和判別器兩部分組成。生成器負責創建新數據,而判別器則評估這些數據的真實性。通過不斷競爭,GAN 能夠產生越來越真實的內容。

Transformer 模型:

Transformer 架構在自然語言處理中取得了顯著成功,並被廣泛應用於文本生成任務。它利用自注意力機制來捕捉序列中元素之間的關聯性,提高了生成效率和質量。

基礎模型(Foundation Models):

這些大型預訓練模型(如 GPT、BERT 和 Stable Diffusion)能夠在多種任務上進行微調,適應不同的應用場景。

提示工程(Prompt Engineering):

在使用生成式 AI 時,如何設計輸入提示對於獲得高質量輸出至關重要。有效的提示能夠引導模型更準確地理解用戶需求並生成相應內容。

生成式AI與LLM大型語言模型的關係. LLM大型語言模型是生成式AI的一個重要分支,專注於自然語言處理和生成。可以說,LLM大型語言模型是生成式AI在語言領域的具體實現。(LLM大型語言模型)的起源可以追溯到自然語言處理(NLP)和神經網絡的發展。

生成式 AI 的興起是多種因素共同作用的結果,而其組成元素則包括神經網絡、GAN、Transformer 模型等核心技術。這些元素共同促進了生成式 AI 在各行各業中的廣泛應用與發展。

👉👉以下是 LLM大型語言模型 的歷史背景和演變過程:

自然語言處理的早期研究:LLM大型語言模型 的概念最早源於 NLP 的研究,這些研究始於20世紀50年代,當時科學家們試圖讓計算機理解和生成人類語言。

早期的 NLP 系統主要依賴於基於規則的方法,使用預定義的規則來解析和生成文本。

神經網絡的引入:

1943年,沃倫·麥卡洛克提出了神經網絡的概念,這為後來的 AI 發展奠定了基礎。隨著計算能力的提升,神經網絡逐漸成為處理 NLP 任務的重要工具。

💢💢演變過程💢💢

統計語言模型:

隨著技術進步,統計語言模型(如 n-gram 模型和隱馬爾可夫模型)開始興起,這些模型通過分析文本數據中的詞頻和詞序來預測下個詞或短語的概率。

長短期記憶網絡(LSTM):

LSTM 和門控循環單元(GRU)等模型在序列數據處理上取得了重大突破,使得模型能夠更有效地捕捉長期依賴關係。

早期基礎 (2017之前):

1.Word2Vec (2013)

📌Google開發

📌首次實現詞向量表示

📌為後續NLP發展奠定基礎

2.RNN/LSTM時代

📌處理序列文本

📌但難以處理長文本

📌存在梯度消失問題

關鍵轉折:Transformer出現 (2017)

1."Attention is All You Need"

📌Google提出Transformer架構

📌革命性的自注意力機制

📌解決了長序列處理問題

📌開啟了LLM大型語言模型時代

LLM大型語言模型發展里程碑:

1.BERT (2018)

📌Google開發

📌雙向編碼器架構

📌預訓練+微調模式

📌大幅提升NLP任務表現

2.GPT系列

📌GPT-1 (2018):OpenAI首個版本

📌GPT-2 (2019):提升生成能力

📌GPT-3 (2020):突破性參數規模

📌GPT-4 (2023):多模態能力

技術演進特點:

1.規模增長

📌參數量暴增

📌訓練數據擴大

📌計算資源提升

2.架構優化

📌注意力機制改進

📌訓練方法創新

📌效率持續提升

3.能力提升

📌理解能力增強

📌生成更自然

📌任務範圍擴大

Transformer 模型的引入:

2017年,Google Research 發表的《Attention Is All You Need》這篇論文確實是自然語言處理領域的一座里程碑。它所提出的 Transformer 模型,徹底改變了我們對序列轉換任務的理解,並引領了自然語言處理領域的一場革命。這一架構利用自注意力機制,同時處理整個序列,大幅提高了效率和性能。隨後,BERT 和 GPT 系列模型相繼問世,標誌著 LLM大型語言模型 的快速發展。

重要里程碑

BERT(2018年):作為一個開源模型,BERT 在各種 NLP 任務中設立了新的基準。

GPT 系列:OpenAI 的 GPT-1、GPT-2 和 GPT-3 分別在2018、2019和2020年發布,每一代都顯著擴大了模型的參數量和能力,使得 LLM大型語言模型 能夠生成更自然、更連貫的文本。

大型語言模型的發展是從早期基於規則的方法到現代深度學習技術的一次重大變革。隨著技術的不斷進步,LLM大型語言模型 現在已經成為理解和生成自然語言的重要工具,在多個領域中展現出強大的應用潛力。

核心區別:

1.範圍與定位

📌生成式AI:更廣泛的概念,包含所有能生成內容的AI技術

📌LLM大型語言模型:特指處理和生成自然語言的大規模模型

2.應用領域

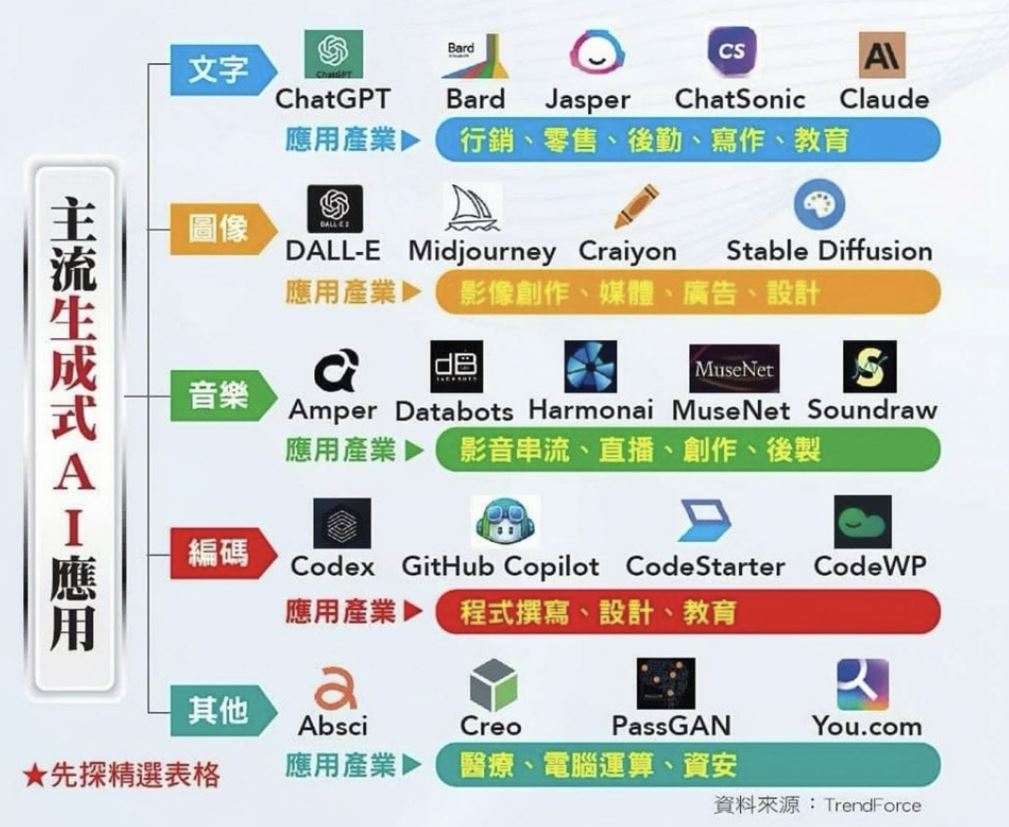

📌生成式AI:可生成文字、圖像、音頻、視頻等多種形式

📌LLM大型語言模型:主要專注於文本理解和生成

技術特點:

1.LLM大型語言模型的獨特之處

📌超大規模參數量(數十億到數千億不等)

📌強大的語言理解和生成能力

📌支持上下文學習和推理

2.訓練方式

📌預訓練:通過大量文本數據學習語言規律

📌微調:針對特定任務進行優化

📌指令跟隨:學習理解和執行人類指令

代表性產品:

1.LLM大型語言模型類

📌GPT系列(ChatGPT等)

📌Claude

📌LLaMA

📌Gemini

2.其他生成式AI

📌圖像:DALL-E、Midjourney、Stable Diffusion

📌音頻:Whisper、AudioCraft

📌視頻:Gen-2、Runway

應用場景的交叉:

📌多模態模型:結合LLM大型語言模型與其他生成能力

📌跨模態轉換:文本到圖像、語音到文本等

📌協同應用:不同類型生成模型的組合使用

然而不是所有的生成式ai都需要大型語言模型(LLM大型語言模型)的 這點我們也要注意

這是因為它們的功能和目標不要求處理複雜的自然語言任務或生成高質量的文本。

這些工具通常依賴於其他形式的深度學習技術,專注於特定的任務或應用場景。

以下是一些不需要LLM大型語言模型的生成式AI工具及其原因:

GAN模型(生成對抗網絡):

應用範圍:主要用於圖像生成、視頻生成和音樂生成。

技術原理:由生成器和判別器組成,通過競爭性訓練來生成高質量的內容。

示例工具:GANPaint Studio、ArtBreeder。

圖像生成技術(如StyleGAN):

應用範圍:創建和編輯圖像,如面部生成、風格轉換。

技術原理:專注於圖像的空間特徵,不需要理解自然語言。

示例工具:DeepArt、Prisma。

音樂生成工具:

應用範圍:創作音樂片段、旋律和伴奏。

技術原理:使用特定的音樂模型來捕捉旋律和節奏。

示例工具:Amper Music、AIVA(Artificial Intelligence Virtual Artist)。

視頻生成和編輯工具:

應用範圍:生成和編輯短視頻內容。

技術原理:使用視頻處理技術和少量的文本輸入來生成視頻。

示例工具:Pika Labs、Runway。

追溯AI影像 藝術的起源|

追溯生成式AI影像藝術的起源是個複雜且多層次的過程。然而,我們可以通過一些關鍵的里程碑來了解這一技術的發展歷程。

最早的生成式AI 影像軟體

最早期嘗試:

1.Cybernetic Serendipity (1968)

📌不是真正的AI,而是電腦藝術

📌使用數學算法生成圖案

📌被視為數位藝術起源

真正的AI圖像生成開端:

數字藝術的誕生(1960年代-1970年代): 在1960年代和1970年代,數字藝術開始興起。藝術家們利用電腦生成簡單的幾何圖形和圖案,這些作品被認為是生成式影像藝術的早期形式。

分形藝術(1980年代): 在1980年代,分形幾何學被應用於藝術創作,創造出了複雜且美麗的圖形。這種技術雖然與現代AI有些不同,但它展示了計算機生成藝術的潛力。

生成對抗網絡(GANs)的革命

生成對抗網絡(GANs)的提出(2014年): 2014年,Ian Goodfellow等人提出了生成對抗網絡(GANs),這一技術徹底改變了生成式影像的發展。GANs由生成器和判別器兩個神經網絡組成,通過對抗訓練生成逼真的圖像。GANs的出現標誌著生成式AI影像藝術的一個重要里程碑。

現代生成式影像工具

DeepDream(2015年): Google於2015年推出的DeepDream,是一個利用神經網絡生成視覺效果的工具。DeepDream通過加強神經網絡中的特徵來生成獨特的藝術圖像,這被認為是現代生成式影像技術的重要應用之一。

DALL-E 和 DALL-E 2(2021年): OpenAI 開發的 DALL-E 和 DALL-E 2 是基於 GPT-3 模型的生成式影像工具。它們可以根據文字描述生成高質量的圖像,展示了生成式AI在影像藝術創作中的巨大潛力。

📌MidJourney 和 Stable Diffusion(2020年代): MidJourney 和 Stable Diffusion 是當前一些最先進的生成式影像工具。MidJourney專注於藝術風格的生成,讓使用者透過文字提示創作各種風格的圖像;Stable Diffusion 則是一個開源的文本到圖像生成模型,能在低資源環境下運行並產生詳細圖像。

生成式 AI 的獨特魅力:從數據中誕生無限可能

生成式 AI 的核心在於其創造性。它不僅能模仿現有數據,還能產生全新的、意想不到的內容。這種能力為藝術、設計、娛樂等領域帶來了無限的可能性,也為各行各業提供了創新的解決方案。

1.追溯AI聲音藝術的起源|

最早期的AI音樂實驗:

在生成式 AI 音樂的歷史中,最早的音樂生成軟體可以追溯到1960年代。以下是一些關鍵的里程碑:

2.1.ILLIAC Suite (1957)

📌被認為是最早的電腦生成音樂

📌由伊利諾伊大學開發

📌使用規則基礎算法

📌不是現代意義的AI生成

2.Rudolf Zaripov:

在1960年,俄羅斯研究員 Rudolf Zaripov 發表了全球第一篇音樂創作演算法的論文,這被認為是 AI 音樂創作的起源之一。

3.David Cope 的 EMI(Experiments in Musical Intelligence):

📌到了1997年,加州大學聖克魯茲分校的音樂教授 David Cope 創作了「Emily Howell」,這是全球第一個音樂智慧實驗系統,能夠模仿巴哈等音樂家的風格。Cope 在2009年發布了第一張「個人」音樂創作專輯《From Darkness, Light》,這標誌著 AI 音樂生成技術的一個重要進展。

4.AARON:

雖然主要是用於圖像生成,但 Harold Cohen 在1970年代開發的 AARON 系統也涉及到音樂創作,顯示了 AI 在藝術創作中的早期應用。

這些早期的系統和研究為後來的 AI 音樂生成技術奠定了基礎。因此,可以說最早的生成式 AI 音樂軟體包括 Zaripov 的論文和 David Cope 的 EMI 系統,而不僅僅是現代的工具如 Suno AI。

早期真正的AI音樂系統:

1.EMI (Experiments in Musical Intelligence) 1987

📌由David Cope開發

📌能分析和模仿作曲家風格

📌被認為是第一個真正的AI作曲系統

📌使用基於模式匹配的算法

2.Band-in-a-Box (1990)

📌雖然最初不是純AI系統

📌但逐漸整合了AI技術

📌可自動生成伴奏和即興演奏

現代意義的生成式AI音樂:

1.FlowMachines (2016)

📌由索尼科技實驗室開發

📌第一個使用深度學習的商業化音樂AI

📌能生成完整的歌曲結構

📌代表性作品:"Daddy's Car"

發展的關鍵階段:

1.規則基礎時期 (1950s-1980s)

📌基於數學規則

📌有限的創造力

📌機械化的輸出

2.模式學習時期 (1980s-2000s)

📌開始使用機器學習

📌能學習音樂模式

📌更自然的輸出

3.深度學習時期 (2010s-至今)

📌使用神經網絡

📌更強的創造能力

📌更高質量的輸出

1.OpenAI的MuseNet (2019)

📌能生成多種風格的音樂

📌支持多種樂器組合

📌基於深度神經網絡

2.Google的Magenta Project

📌Music Transformer (2018)

📌提供多種音樂生成模型

📌包括旋律和和聲生成

3.Amper Music (2017)

📌專業的AI作曲工具

📌支持自定義風格

📌商業化應用較早

4.AIVA Technologies (2016)

📌專注於情感音樂創作

📌支持多種音樂風格

📌已被廣泛商業應用

SUNO AI的創新之處:

1.技術優勢

📌更自然的音樂生成

📌更好的文本理解能力

📌更快的生成速度

2.使用便利性

📌更直觀的操作界面

📌更簡單的提示詞要求

📌更快的學習曲線

3.輸出品質

📌更高的音樂品質

📌更好的風格控制

📌更自然的過渡效果

結論:

📌SUNO AI並非首創

📌但確實帶來新的突破

📌代表了技術演進的新階段

1提供了更好的用戶體驗

Udio AI跟 Suno ai跟 MuseNet他們已經是生成式AI裡 最強大的軟體 跟前一代音樂製作軟體Acid Pro \Music Maker \FL Studio\Studio One Prime 比起來不同點在哪裡

傳統音樂製作軟體(DAW)的運作原理:

💢MIDI 序列器:

📌記錄和播放MIDI數據(音符、力度、控制信息等)

📌基於時間軸的線性編輯系統

💢數位音頻處理:

📌波形採樣和編輯

📌實時效果器處理(混響、延遲等)

📌基於數學算法的聲音處理

💢混音引擎:

📌多軌道混音

📌聲道路由

📌即時音頻運算

2.AI音樂生成工具(Suno AI/Udio AI)的運作原理:

💢深度學習模型:

📌基於大規模音樂數據集訓練

📌使用機器學習算法理解音樂結構

📌涉及多個AI模型協同工作:

文本理解模型(處理提示詞)

音樂生成模型

聲音合成模型

💢神經網絡架構:

📌使用Transformer等架構理解音樂語言

📌可能運用了GAN或擴散模型來生成音頻

📌包含音樂理論規則的嵌入學習

💢生成過程:

1.分析文字提示

2.生成音樂結構框架

3.創建旋律和和聲

4.生成配器和編曲

5.合成最終音頻

3.主要技術差異:

💢傳統DAW:

📌基於確定性算法

📌直接操作音頻數據

📌實時處理為主

💢AI工具:

📌基於概率模型

📌從高層次特徵生成

📌批量處理為主

這就是為什麼AI工具能夠"理解"音樂創作的更高層面概念,而傳統DAW則專注於提供精確的音頻處理控制。

總結

生成式 AI、LLM 大型語言模型和 GPU 的結合,推動了 AI 藝術的飛速發展。從早期的簡單圖形生成,到如今能夠生成複雜的藝術作品,AI 藝術已經取得了令人矚目的成就。未來,隨著技術的不斷進步,AI 藝術將繼續為我們帶來更多的驚喜。生成式 AI 的核心在於其創造性。它不僅能模仿現有數據,還能產生全新的、意想不到的內容。這種能力為藝術、設計、娛樂等領域帶來了無限可能,也為各行各業提供了創新的解決方案。

最後,讓我們一起來觀看幾個深入講解生成式 AI 關鍵原理的影片,這些資源可以幫助大家對生成式 AI 有更正確的觀念和視野:

90分鐘深度!一口氣看明白人工智慧和神經網路

VIDEO 走進「卷積神經網路」,瞭解圖像識別背後的原理

VIDEO 什麼是大型語言模型? LLM是什麼?| AI基礎觀念-2

VIDEO Transformer模型詳解,Attention is all you need

VIDEO 8分鐘帶你走進神經網路模型、機器學習的世界

VIDEO 敬請期待我們的下一期內容,我們將深入探討生成式 AI 在影像和聲音方面的知名軟體及其發展狀況。未來的發展值得期待!